今天,著名的SemiAnalysis分析师Dylan Patel和Daniel Nishball,又来爆料行业内幕了。

而整个AI社区,再次被这次的消息所震惊:OpenAI的算力比起谷歌来,只能说是小儿科。

谷歌的下一代大模型Gemini,算力已达GPT-4的5倍!

根据Patel和Nishball的说法,此前屡屡被爆料将成为GPT-4大杀器的谷歌Gemini,已经开始在新的TPUv5 Pod上进行训练了,算力高达~1e26 FLOPS,比训练GPT-4的算力还要大5倍。

如今,凭借着TPUv5,谷歌已经成为了算力王者。它手中的TPUv5数量,比OpenAI、Meta、CoreWeave、甲骨文和亚马逊拥有的GPU总和还要多!

虽然TPUv5在单芯片性能上比不上英伟达的H100,但谷歌最可怕的优势在于,他们拥有高效、庞大的基础设施。

没想到,这篇爆料引来Sam Altman围观,并表示,“难以置信的是,谷歌竟然让那个叫semianalysis的家伙发布了他们的内部营销/招聘图表,太搞笑了。 ”

有网友却表示,这仅是一篇评论性文章,并非实际新闻,完全是推测。

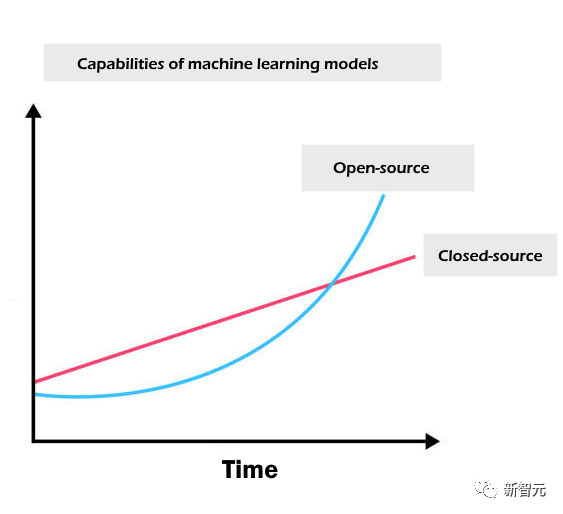

不过,此前Dylan Patel参与的两篇稿件,无一例外都被证实,并且引发了业内的轩然大波。无论是谷歌的内部文件泄露事件(“我们没有护城河,OpenAI也没有”)——

谷歌DeepMind的首席执行官Demis Hassabis在一次采访中确认了谷歌护城河的真实性

还是GPT-4的架构、参数等内幕消息大泄密——

下面让我们来仔细看看,这次的爆料文章,又将带来多少重磅内幕消息。

沉睡的巨人谷歌已经醒来

提出Transformer开山之作“Attention is all you need”的作者之一、LaMDA和PaLM的关键参与者Noam Shazeer,曾受MEENA模型的启发,写过一篇文章。

在这篇文章里,他准确地预言了ChatGPT的诞生给全世界带来的改变——LLM会越来越融入我们的生活,吞噬全球的算力。

这篇文章远远领先于他的时代,但却被谷歌的决策者忽略了。

论文地址:https://arxiv.org/pdf/2001.09977.pdf

现在,谷歌拥有算力王国所有的钥匙,沉睡的巨人已经醒来,他们的向前迭代的速度已经无法阻挡,在2023年底,谷歌的算力将达到GPT-4预训练FLOPS的五倍。

而考虑谷歌现在的基建,到明年年底,这个数字或许会飙升至100倍。

谷歌是否会在不削减创造力、不改变现有商业模式的基础上在这条路上继续深耕?目前无人知晓。

“GPU富豪”和“GPU穷人”

现在,手握英伟达GPU的公司,可以说是掌握了最硬的硬通货。

OpenAI、谷歌、Anthropic、Inflection、X、Meta这些巨头或明星初创企业,手里有20多万块A100/H100芯片,平均下来,每位研究者分到的计算资源都很多。

个人研究者,大概有100到1000块GPU,可以玩一玩手头的小项目。

CoreWeave已经拿英伟达H100抵押,用来买更多GPU

而到2024年底,GPU总数可能会达到十万块。

现在在硅谷,最令顶级的机器学习研究者自豪的谈资,就是吹嘘自己拥有或即将拥有多少块GPU。

在过去4个月内,这股风气越刮越盛,以至于这场竞赛已经被放到了明面——谁家有更多GPU,大牛研究员就去哪儿。

Meta已经把“拥有世界上第二多的H100 GPU”,直接拿来当招聘策略了。

与此同时,数不清的小初创公司和开源研究者,正在为GPU短缺而苦苦挣扎。

因为没有足够虚拟内存的GPU,他们只能虚掷光阴,投入大量时间和精力,去做一些无关紧要的事。

他们只能在更大的模型上来微调一些排行榜风格基准的小模型,这些模型的评估方法也很支离破碎,更强调的是风格,而不是准确性、有用性。

他们也不知道,只有拥有更大、更高质量的预训练数据集和IFT数据,才能让小开源模型在实际工作负载中得到改进。

“谁将获得多少H100,何时获得H100,都是硅谷现在的顶级八卦。”OpenAI联合创始人Andrej Karpathy曾经这样感慨

是的,高效使用GPU很重要,许多GPU穷人把这一点忽视了。他们不关心规模效应的效率,也没有有效利用自己的时间。

到明年,世界就会被350万H100所淹没,而这些GPU穷人,将彻底与商业化隔绝。他们只能用手中的游戏用GPU来学习、做实验。

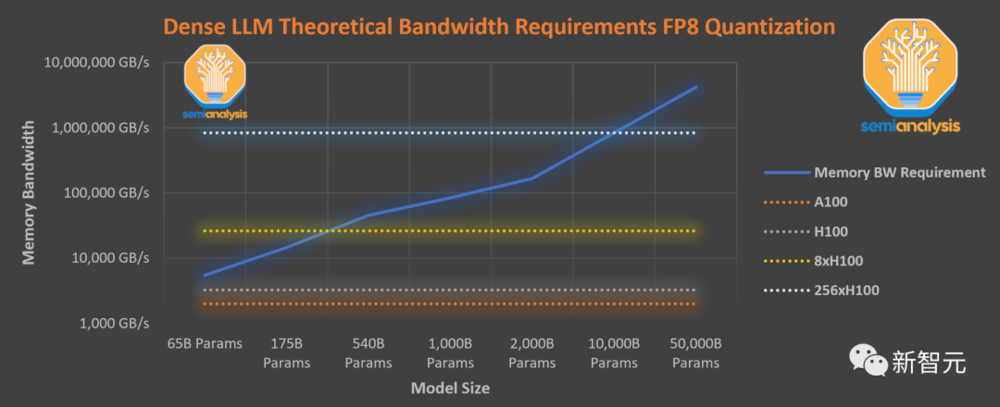

大部分GPU穷人仍然在使用密集模型,因为这就是Meta的Llama系列模型所提供的。

如果不是扎克伯格的慷慨,大部分开源项目会更糟。

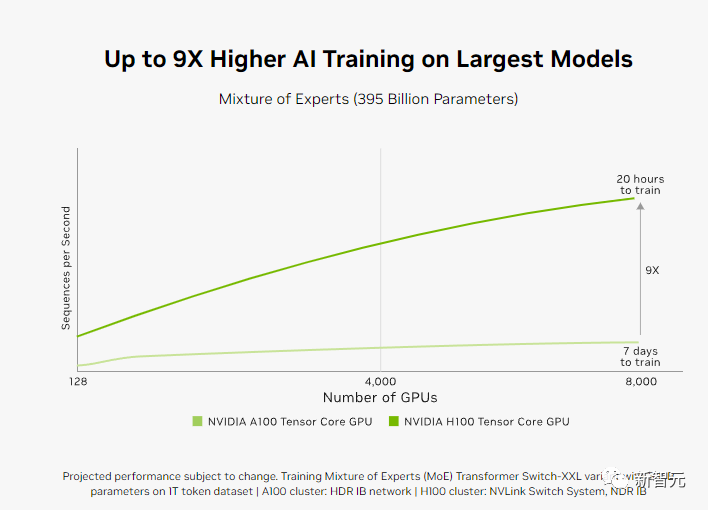

如果他们真的关心效率,尤其是客户端的效率,他们会选择MoE这样的稀疏模型架构,并且在更大的数据集上进行训练,并且像OpenAI、Anthropic、Google DeepMind这样的前沿LLM实验室一样,采用推测解码。

此图表假设,无法融合每个操作、注意力机制所需的内存带宽、硬件开销相当于参数读取,都会导致效率低下。实际上,即使使用优化的库,比如英伟达的FasterTransformer库,总开销甚至还会更大

处于劣势的公司应该把重点放在提高模型性能或减轻token到token延迟上,提高计算和内存容量要求,减少内存带宽,这些才是边缘效应所需要的。

他们应该专注于在共享基础架构上高效地提供多个微调模型,而不必为小批量模型付出可怕的成本代价。

然而,事实却恰恰相反,他们却过于关注内存容量限制或量化程度太高,却对模型实际质量的下降视而不见。

总的来说,现在的大模型排行榜,已经完全乱套了。

虽然闭源社区还有很多人在努力改进这一点,但这种开放基准毫无意义。

出于某种原因,人们对LLM排行榜有一种病态的痴迷,并且为一些无用的模型起了一堆愚蠢的名字,比如Platypus等等。

在以后,希望开源的工作能转向评估、推测解码、MoE、开放IFT数据,以及用超过10万亿个token清洗预训练数据,否则,开源社区根本无法与商业巨头竞争。

现在,在大模型之战的世界版图已经很明显:美国和中国会持续领先,而欧洲因为缺乏大笔投资和GPU短缺已经明显落后,即使有政府支持的超算儒勒·凡尔纳也无济于事。而多个中东国家也在加大投资,为AI建设大规模基础设施。

当然,缺乏GPU的,并不只是一些零散的小初创企业。

即使是像HuggingFace、Databricks(MosaicML),以及Together这种最知名的AI公司,也依然属于“GPU贫困人群”。

事实上,仅看每块GPU所对应的世界TOP级研究者,或者每块GPU所对应的潜在客户,他们或许是世界上最缺乏GPU的群体。

虽然拥有世界一流的研究者,但所有人都只能在能力低几个数量级的系统上工作。

虽然他们获得了大量融资,买入了数千块H100,但这并不足以让他们抢占大部分市场。

你所有的算力,全是从竞争公司买的

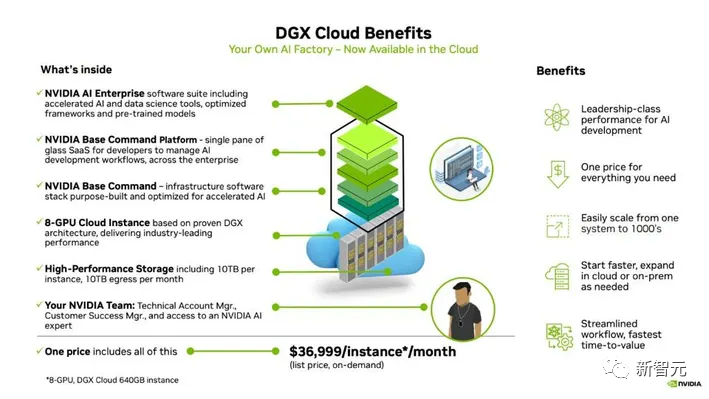

在内部的各种超级计算机中,英伟达拥有着比其他人多出数倍的GPU。

其中,DGX Cloud提供了预训练模型、数据处理框架、向量数据库和个性化、优化推理引擎、API以及英伟达专家的支持,帮助企业定制用例并调整模型。

如今,这项服务也已经吸引了来自SaaS、保险、制造、制药、生产力软件和汽车等垂直行业的多家大型企业。

即便是不算上那些未公开的合作伙伴,仅仅是由安进(Amgen)、Adobe、CCC、ServiceNow、埃森哲(Accenture)、阿斯利康(AstraZeneca)、盖蒂图片社(Getty Images)、Shutterstock、晨星(Morningstar)、Evozyne、Insilico Medicine、Quantiphi、InstaDeep、牛津纳米孔(Oxford Nanopore)、Peptone、Relation Therapeutics、ALCHEMAB Therapeutics和Runway等巨头组成的这份比其他竞争对手要长得多的名单,就已经足够震撼了。

考虑到云计算的支出和内部超级计算机的建设规模,企业从英伟达这里购买的似乎比HuggingFace、Together和Databricks所能够提供的服务加起来还要多。

作为行业中最有影响力的公司之一,HuggingFace需要利用这一点来获得巨额投资,建立更多的模型、定制和推理能力。但在最近一轮的融资中,过高的估值让他们并没有得到所需的金额。

Databricks虽然可以凭借着数据和企业关系迎头赶上。但问题在于,如果想要为超过7,000个客户提供服务,就必须将支出增加数倍。

不幸的是,Databricks无法用股票来购买GPU。他们需要通过即将开始的私募/IPO来进行大规模融资,并进一步用这些现金来加倍投资于硬件。

从经济学的角度来看有些奇怪,因为他们必须先建设,然后才能引来客户,而英伟达同样也在为他们的服务一掷千金。不过,这也是参与竞争的前提条件。

这里的关键在于,Databricks、HuggingFace和Together明显落后于他们的主要竞争对手,而后者又恰好是他们几乎所有计算资源的来源。

也就是说,从Meta到微软,再到初创公司,实际上所有人都只是在充实英伟达的银行账户。

那么,有⼈能把我们从英伟达奴役中拯救出来吗?

是的,有⼀个潜在的救世主——谷歌。

谷歌算⼒之巅,OpenAI不及一半

虽然内部也在使用GPU,但谷歌的手中却握着其他“王牌”。

其中,最让业界期待的是,谷歌下一代大模型Gemini,以及下一个正在训练的迭代版本,都得到了谷歌⽆与伦⽐的⾼效基础设施的加持。

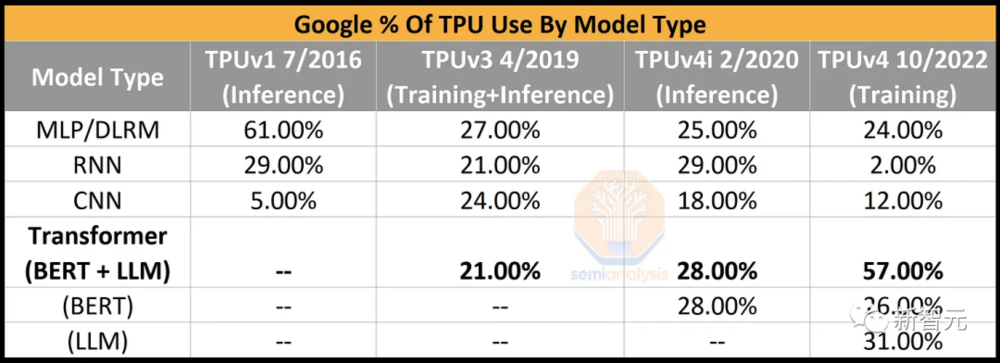

早在2006年,谷歌就开始提出了构建人工智能专用基础设施的想法,并于2013年将这一计划推向高潮。

他们意识到,如果想大规模部署人工智能,就必须将数据中心的数量增加一倍。

因此,谷歌开始为3年后能够投入生产的TPU芯片去做准备。

最著名的项目Nitro Program在13年发起,专注于开发芯片以优化通用CPU计算和存储。主要的目标是重新思考服务器的芯片设计,让其更适合谷歌的人工智能计算工作负载。

自2016年以来,谷歌已经构建了6种不同的AI芯片,TPU、TPUv2、TPUv3、TPUv4i、TPUv4和TPUv5。

谷歌主要设计这些芯片,并与Broadcom进行了不同数量的中后端协作,然后由台积电生产。

TPUv2之后,这些芯片还采用了三星和SK海力士的HBM内存。

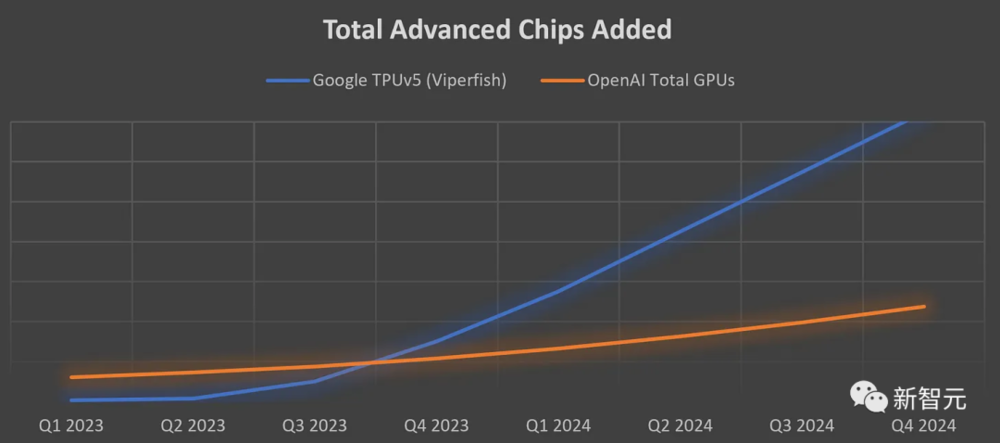

在介绍Gemini和谷歌的云业务之前,爆料者先分享了关于谷歌疯狂扩张算力的一些数据——各季度新增加的⾼级芯⽚总数。

对于OpenAI来说,他们拥有的总GPU数量将在2年内增加4倍。

而对于谷歌来说,所有人都忽视了,谷歌拥有TPUv4(PuVerAsh)、TPUv4 lite,以及内部使⽤的GPU的整个系列。

此外,TPUv5 lite没有在这里算进去,尽管它可能是推理较⼩语⾔模型的主⼒。

如下图表中的增长,只有TPUv5(ViperAsh)可视化。

即使对他们的能力给予充分肯定,谷歌的算力也足以让所有人都傻了眼。

实际上,谷歌拥有的TPUv5比OpenAI、Meta、CoreWeave、甲骨文和亚马逊拥有的GPU总和还要多。

并且,谷歌能够将这些能力的很大一部分出租给各种初创公司。

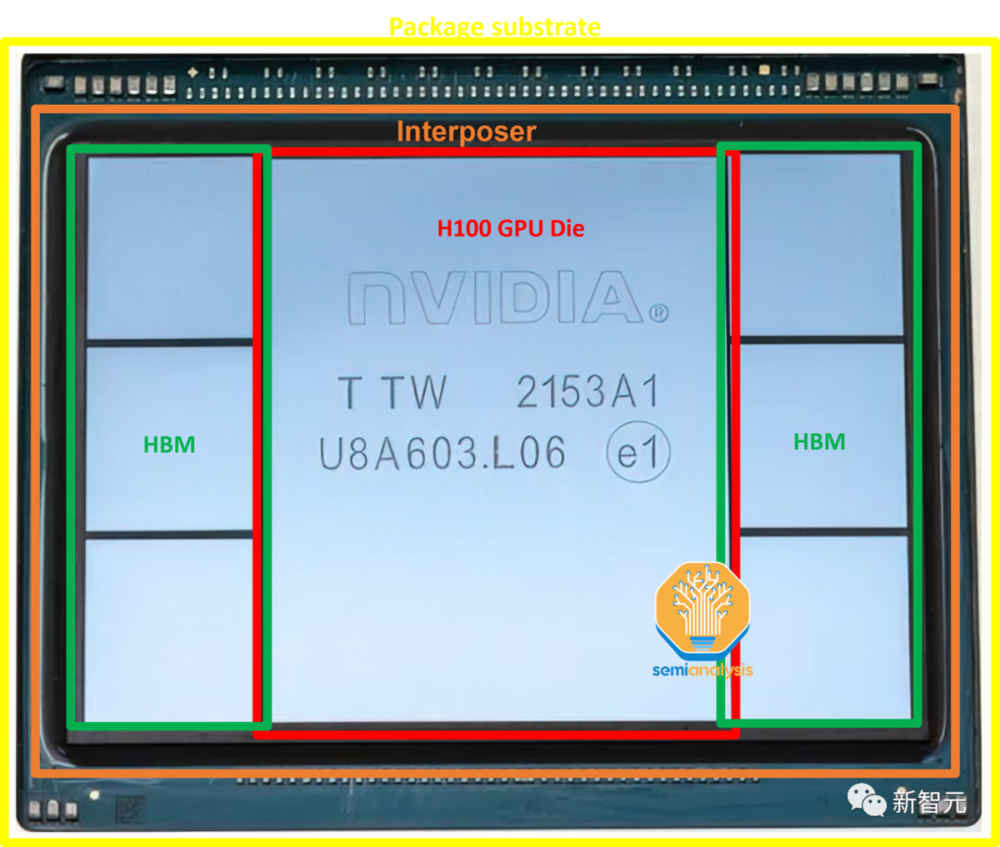

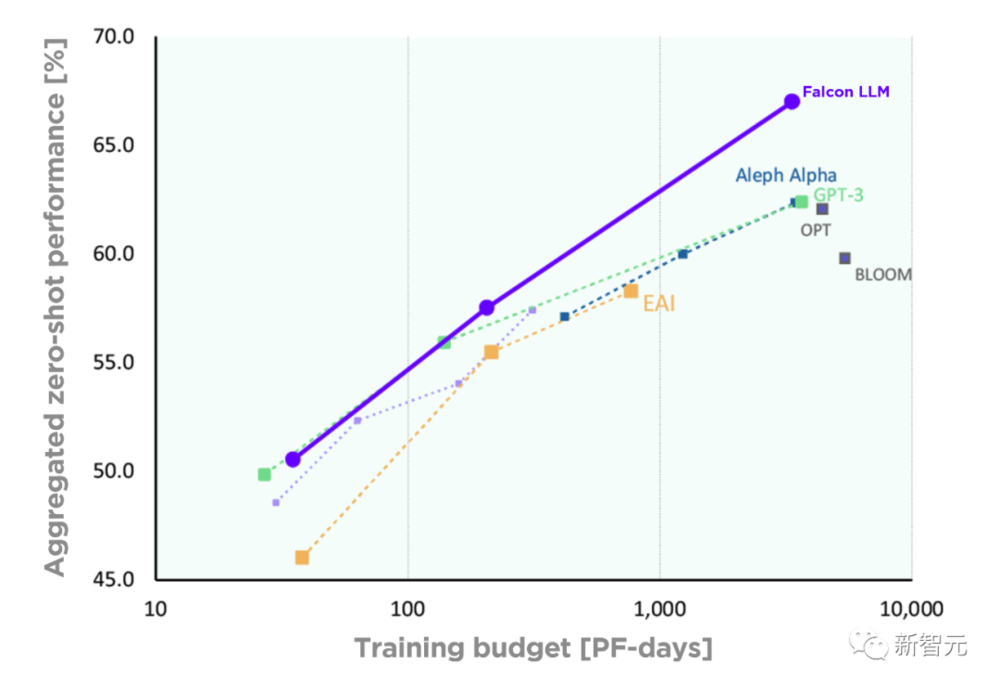

当然,就每个芯片方面的性能来说,TPUv5与H100相比有显著的差距。

撇开这点不说,OpenAI的算力只是谷歌的一小部分。与此同时,TPUv5的构建能够大大提升训练和推理能⼒。

此外,谷歌全新架构的多模态大模型Gemini,一直在以令人难以置信的速度迭代。

据称,Gemini可以访问多个TPU pod集群,具体来讲是在7+7 pods上进行训练。

图片来自:Google I/O大会

爆料者表示,初代的Gemini应该是在TPUv4上训练的,并且这些pod并没有集成最大的芯片数——4096个芯⽚,而是使用了较少的芯片数量,以保证芯片的可靠性和热插拔。

如果所有14个pod都在合理的掩模场利用率(MFU)下使⽤了约100天,那么训练Gemini的硬件FLOPS将达到超过1e26。

作为参考,爆料者在上次“GPT-4架构”文章中曾详细介绍了GPT-4模型的FLOPS比2e25稍高一点。

而⾕歌模型FLOPS利⽤率在TPUv4上⾮常好,即使在⼤规模训练中,也就是Gemini的第⼀次迭代,远远⾼于GPT-4。

尤其是,就模型架构优越方面,如增强多模态,更是如此。

真正令人震惊的是Gemini的下一次迭代,它已经开始在基于TPUv5的pod上进⾏训练,算力高达~1e26 FLOPS,这比训练GPT-4要大5倍。

据称,第⼀个在TPUv5上训练的Gemini在数据⽅⾯存在⼀些问题,所以不确定谷歌是否会发布。

这个~1e26模型可能就是,公开称为Gemini的模型。

再回看上⾯的图表,这不是⾕歌的最终形态。⽐赛已经开始了,而⾕歌有着巨⼤的优势。

如果他们能够集中精力并付诸实施,至少在训练前的计算规模扩展和实验速度方面,他们终将胜出。

他们可以拥有多个比OpenAI最强大的集群,还要强大的集群。谷歌已经摸索了一次,还会再来一次吗?

当前,⾕歌的基础设施不仅满⾜内部需求,Anthopic等前沿模型公司和⼀些全球最⼤的公司,也将访问TPUv5进⾏内部模型的训练和推理。

⾕歌将TPU迁移到云业务部门,并重新树立了商业意识,这让他们赢得了一些大公司的青睐果断战斗。

未来几个月,你将会看到谷歌的胜利。这些被推销的公司,有的会为它的TPU买单。

参考资料:

https://www.semianalysis.com/p/google-gemini-eats-the-world-gemini

本文来自微信公众号:新智元 (ID:AI_era),作者:新智元